Las mecánicas jugables permiten la relación entre el jugador y los mundos presentes dentro del videojuego. Se suele asumir el salto como la mecánica básica por excelencia dentro del videojuego, pero aceptar esto de forma incuestionable es dar por supuestos y sabidos demasiados aspectos previos y saltarse (no pun intended*… bueno, un poco sí) demasiadas cosas que se deberían contemplar, cuestionar y/o analizar antes.

Es parte fundamental de la forma en que nos relacionamos con el mundo que nos rodea. Videojuegos al margen, el movimiento enlaza de manera directa con cómo ocupamos el espacio a nuestro alrededor. El movimiento está relacionado con cómo ocupamos el espacio, pero no con la existencia propia —en tanto que no son conceptos obligatoriamente ligados— por lo que el no-movimiento también entra dentro de ese campo que es el cómo se ocupan los lugares, lo que por consiguiente significa que las tres ideas se relacionan entre sí: Existencia, ocupación del espacio y movimiento/no-movimiento. Explicado de forma más sencilla, alguien postrado en una cama también experimenta algún tipo de relación con su entorno, reacciona a estímulos, etc. por lo que debe de haber algo anterior incluso al propio movimiento que sea extrapolable a la interacción del jugador con aquello que ocurre en pantalla. Asumida la existencia en el mundo real como algo separado del movimiento, en su tratamiento (de la existencia) dentro del mundo del videojuego esta es mediante la adopción del papel de jugador —un ente que juega—, lo que implica la asunción de una comunicación básica anterior incluso al movimiento: la reacción a estímulos. Los estímulos y su reacción a ellos son en consecuencia la parte más básica de la interacción entre juego y jugador. Acción y reacción.

¿Quién inicia el discurso del videojuego? ¿El jugador que inserta el disco en su consola —y se reafirma: yo juego— o los desarrolladores que desde el momento en que el lector de la consola pone en marcha todo el proceso comienzan a mandar información (una cinemática de inicio, música, menús, etc…), incluso antes de que el jugador toque el mando?

Es complicado dirimir esta cuestión pues ambos se retroalimentan y se necesitan. El jugador se sienta frente a su pantalla como receptor y eso ya supone un primer mensaje: “Estoy aquí y estoy dispuesto a escuchar. ¿Qué tienes para decirme?” pero el videojuego existe incluso antes de esto, incluso si nadie lo juega, existe un mensaje previo del desarrollador que se da con la propia existencia del juego: “Tengo esto que decir ¿Quieres escucharme?”. El videojuego presenta una serie de informaciones a través de todos esos elementos (cinemáticas de inicio, música, menús, etc.) que continúan una vez empieza la partida, comunicando al jugador cuál es la ambientación, el tono del juego, el arte, las decisiones estéticas y demás… La más básica quizás: la interfaz de usuario.

La interfaz de usuario

La interfaz de usuario hace referencia a los medios mediante los cuales un sistema informático y su usuario interactúan entre sí, y más específicamente a la forma de usar los dispositivos de entrada y el software para llevar a cabo esa comunicación.

Dentro de los videojuegos son los medios que permiten al jugador operar dentro de este, pudiendo distinguir entre dos tipos según el sistema de comunicación que establezcan:

- Inputs: De fuera a dentro, o del espacio real al digital, y

- Outputs: De dentro a fuera, o del espacio digital al real.

En ambos casos su diseño debe de ir enfocado a que su usabilidad sea lo más satisfactoria posible, entendiendo por usabilidad la facilidad de uso de un software informático o de una herramienta gracias a una fácil lectura y entendimiento de la información, rapidez en su manejo, comodidad, etc.

Inputs

Los llamados inputs son controladores como el teclado, el ratón o el mando de la consola, y deben de tener en cuenta distintos factores; unos que no dependen directamente del desarrollador de videojuegos, como pueden ser el diseño y la ergonomía del controlador, la latencia o tiempo de respuesta desde que ejecutamos una acción hasta que vemos su resultado en pantalla, o la sensibilidad y el feedback que transmita cada botón una vez que es pulsado, y otros que sí dependen directamente del videojuego, como la kinestesia o el mapeado del controlador.

Centrémonos en el mando de Playstation como controlador de referencia.

El mapeado del mando es la distribución de las acciones en cada uno de los botones, palancas, gatillos y combinaciones de todos estos para conseguir un control satisfactorio durante la partida. Depende de cuestiones como el género al que pertenezca el videojuego o la jugabilidad y su evolución, pues todas estas variables hacen que en el juego tengan más peso unas acciones sobre otras o que algunas ni siquiera existan dentro del título. No es lo mismo la forma de asignar los botones en un hack and slash que en un shooter o que en un plataformas y, por supuesto, puede existir por parte de los propios desarrolladores la intencionalidad de colocar la distribución de las acciones en el mando de manera poco natural para el jugador con el fin de condicionar su experiencia buscando trasladar una sensación de incomodidad más allá de la pantalla, como ocurre en “Resident Evil 2″, donde se conseguía la sensación de peligrosidad y supervivencia en una ciudad infestada de zombies mediante unos controles toscos —entre otras muchas cosas—, o incluso recientemente en “Resident Evil 7″, donde el movimiento a la hora de apuntar se hacía más molesto y “difícil” que en un shooter de corte más tradicional reforzando la idea de que nuestro avatar no era ningún tirador experto con formación en ese campo.

En “Cuphead” el mapeado por defecto de los controles sitúa el salto en la equis, el disparo en el cuadrado, y el dash en el triángulo. Y esto es un problema porque “Cuphead” mecánicamente se sitúa a medio camino entre el run and gun (traducido al español como corre y dispara) y los plataformas. Sus mecánicas más importantes son el esquivar los ataques de los jefes mediante saltos y dashes, y disparar porque cuanto más daño y más constante lo hagas antes puedes derrotar a cada enemigo reduciendo las posibilidades de que uno de sus ataques te alcance y acabe contigo. Además el disparo te permite evitar algunos proyectiles disparándoles en lugar de esquivarlos. Pero con los controles por defecto propuestos por Studio MDHR, para disparar y saltar a la vez tienes que mantener el disparo pulsado —dedo pulgar— y cada vez que quieras saltar darle al botón con la parte baja del dedo —también pulgar—, perdiendo sensibilidad y precisión. Para saltar y hacer un dash tienes que pulsar primero el salto y luego mover el mismo dedo con el que estás saltando hacia el botón que tiene justo encima, perdiendo unos segundos en un control incómodo que funciona mucho mejor situando el salto en la equis, el disparo en el gatillo derecho y el dash en el izquierdo por ejemplo —la idea es que cada acción esté asignada a un dedo— dejando todas las acciones más recurrentes mucho más a mano. Y estos son errores de un título que salió a la venta en 2017, cuando el estudio ergonómico y el mapeado de los controles deberían estar asumidos de forma más natural.

No es el único caso reciente. Dentro del género de la lucha el esquema de control se suele situar de dos formas. La primera: asignando un par de botones frontales del lado derecho para los puñetazos y el par restante para las patadas —el conjunto de botones equis, cuadrado, círculo y triángulo en Playstation— quedando la distribución de botones de forma que cada uno de estos controla un miembro del cuerpo. La segunda opción es distinguir entre ataques flojos, medios y fuertes, asignando cada uno a un botón y dejando el sobrante para cualquier otra función (un ataque especial, desviar ataques, etc.).

Estas divisiones popularizaron el uso de los arcade sticks por el fácil acceso a cada botón con cada dedo de forma independiente, evitando tener que pasar de uno a otro con un solo dedo. Si, por ejemplo, asignamos al botón 1 el dedo 1 y al botón 2 el dedo 2, será más fácil realizar un combo alternando las pulsaciones entre el dedo 1 y 2 que si el dedo 1 tiene que moverse al botón 1, luego al botón 2 y finalmente regresar al botón 1, algo que en el uso de mandos requiere, en los casos más exigentes, más velocidad. El número disponible de botones dentro de una consola es el que es y no es algo fácilmente solucionable, más allá de que los propios desarrolladores extiendan los márgenes de tiempo para pulsar cada botón a la hora de confirmar un combo, pero sí que existen otras decisiones más torpes y cuestionables a la hora de mapear el control. En “Mortal Kombat X” existe una decisión de diseño en su mapeado que desentona completamente con los esquemas mencionados: el bloqueo. Cubrirse en el título de lucha de NetherRealm Studios está situado en el gatillo trasero derecho (R2) cuando lo habitual para defenderse en el género es simplemente mantener (o pulsar) el botón en dirección hacia la espalda de nuestro avatar. Con el cambio en “Mortal Kombat X” se vuelve todo mucho más farragoso al resituar el esquema de control de forma que ahora las acciones de defensa recaen en el mismo lado del mando que las de ataque, y además añade un botón más a la hora de defenderse de los ataques bajos.

En cuanto a la evolución del mapeado de los mandos junto a la jugabilidad y la evolución de los propios mandos, los first person shooters son un buen ejemplo. No es lo mismo el control del primer “DOOM”, el cual se jugaba con teclado y ratón y únicamente podías moverte en los ejes X y Z, que el de “GoldenEye 007” que se jugaba en la Nintendo 64 y cuyo control era un infierno. En la versión expandida de “Metal Gear Solid 2″ había algunas misiones de “VR” que se desarrollaban en primera persona cuyo control no era mucho mejor, con opciones cuestionables tanto en la forma de moverse como en las acciones asignadas a cada botón. Además, todas las acciones que incluían usar armas estaban localizadas en el cuadrado y llegarían así hasta “Metal Gear Solid 3″, por lo que el poco recorrido que existía en el botón provocaba que muchas veces el acto de interrogar a un soldado enemigo acercándole un cuchillo al cuello o el de apuntar a objetivos acabase con la ejecución involuntaria del interrogado por haber presionado de más el botón —cortándole el cuello— o disparando por accidente antes de terminar de apuntar.

Lo que nos lleva al segundo punto responsabilidad de los diseñadores dentro de la información que funciona de fuera a dentro del juego: La kinestesia.

La kinestesia es definida en “Game Feel” por Steve Swink como la parte de la sensación de juego referida al control, tanto dentro como fuera del juego. Con esto se refiere no únicamente a un control cómodo como ya hemos visto, si no también a que este comunique de forma satisfactoria las sensaciones que debe.

La evolución en el mapeado de los controles en los shooters modernos por ejemplo, propició que se adoptasen esquemas de control que se extendieron a la mayoría de títulos que aún hoy día se conservan. Ya no es sólo una cuestión de facilidad como lo es el colocar acciones como lanzar granadas en los gatillos traseros volviendo el movimiento mucho más dinámico, sino decisiones como situar la acción de disparar en los gatillos superiores, normalmente en el derecho dejando este lado del mando para el control del arma y el izquierdo para el movimiento de nuestro avatar. Este cambio refuerza una abstracción kinestésica: el gatillo del mando se convierte en el gatillo del arma y ambos se accionan de la misma forma, su recorrido es similar, etc.

Se busca reforzar en el mundo exterior las sensaciones del mundo del juego, así, además del uso que se haga de los controles, encontramos otros aspectos que refuerzan esa kinestesia, como la sensación de peso de las armas por ejemplo, su potencia, cómo actúan las físicas del juego y cómo afectan a nuestro avatar, y una gran cantidad de puntos más que dependen directamente del juego y lo que se quiera comunicar con él y, por supuesto, si se hace bien o no. Es aquello que hace que por ejemplo los golpes de Batman en la saga Arkham se sientan tan contundentes.

Una vez establecido el concepto de interfaz de usuario y cómo esta se divide entre inputs y outputs a la hora de empezar un diálogo entre el videojuego y el jugador, es momento de profundizar en la parte que nace directamente en el mundo digital y se comunica desde este con el usuario.

Los inputs recogen muchos elementos que no dependen directamente del desarrollador de videojuegos. Desde el estudio de desarrollo se pueden asignar los botones al mapeado del mando como este crea conveniente, pero no es un campo en el que tengan el control absoluto. El software puede recoger que para saltar dentro del juego tengas que pulsar la X o incluso que dentro del juego no se salte, pero no tienen capacidad de decisión en partes como que el controlador disponga de 2 botones más; sin embargo los outputs sí es algo sobre lo que tienen más libertad de elección y aparentemente sólo están limitados por la potencia del propio hardware y la decisión de respetar o no algunas normas básicas a la hora de diseñar estos.

Outputs

Son aquellos elementos que transmiten información de utilidad para el jugador. En “Assassin’s Creed Unity” por ejemplo, se utilizan métodos como el sonido que complementa la transmisión de información al jugador para, en caso de desactivar el HUD, que este siga disponiendo de los datos que necesite para tomar decisiones.

Evidentemente esto sitúa al HUD dentro de los outputs, pero existen muchos otros como todos los menús que el jugador recorre desde que inicia la partida hasta que la acaba.

No es simplemente introducir datos y ya está; a la hora de diseñar el HUD y los menús de un videojuego hay que tener en cuenta varias ópticas:

En primer lugar se debe considerar que la función de estos es la de aportar información de valor al jugador, por lo que es necesario tener en cuenta cuál es la de mayor utilidad y darle prioridad a esta estableciendo algún tipo de escala de valores según su relevancia. Dicha escala funciona contemplando entre otras cosas las mecánicas jugables, los medios disponibles para comunicar y distribuir la información o incluso las teorías de la percepción visual.

Según el tipo de videojuego frente al que nos encontremos la información más relevante cambiará dependiendo de las mecánicas y el diseño. En “Hotline Miami” no necesitamos una barra de salud en pantalla pues morimos de un solo impacto, sin embargo en “Nuclear Throne” vemos constantemente nuestra vida arriba a la izquierda, al igual que en Dark Souls y otros tantos. Esto se relaciona directamente con dos aspectos: la forma de jugar y la forma de observar.

Veamos lo relativo al primer aspecto (la forma de jugar) utilizando la propia barra de salud como ejemplo.

La forma en que jugamos a un título viene determinada por su género y sus mecánicas, así pues en un título como “DOOM” en el que id Software busca convertirlo en un shooter frenético, la salud aparece en pantalla abajo a la izquierda. Es lo suficientemente importante como para que tengamos que tenerla algo presente recordándonos que existe una mecánica mediante la cual podemos recuperar salud ejecutando demonios, pero no tanto como para preocuparnos demasiado por ella al punto de provocar que en lugar de ser agresivos pasemos más tiempo del que deberíamos escondidos tras parapetos.

Sin embargo, en shooters en los que se busca que el jugador se mueva entre coberturas, la barra de salud se elimina y en su lugar se coloca salud regenerativa, con lo que nuestro avatar puede soportar el suficiente daño como para permitir arriesgarnos a desplazarnos de un sitio a otro pero obligándonos siempre a buscar un resguardo en lugar de quedarnos a pecho descubierto en medio del campo de batalla.

La saga Call of Duty ha pasado por estos dos escenarios recientemente. En “Call of Duty: WWII” se pasó de la salud regenerativa de la entrega anterior (“Call of Duty: Infinite Warfare”) a una barra de salud tradicional en la que esta se recuperaba mediante el uso de botiquines. Se acentúa el que el jugador no se exponga tanto en cada desplazamiento —reforzando la idea de la guerra de trincheras— pero el daño que recibimos no es tan importante, procurando que el título mantenga parte del dinamismo que caracteriza a la saga.

En otros donde la salud tiene más importancia encontramos la misma barra arriba a la izquierda. Por ejemplo en la saga Souls y en “Bloodborne”, aunque las aproximaciones a cada uno sean distintas. En los Souls la importancia de la salud radica en administrar bien los tiempos para curarte durante los combates a la vez que racionas de forma correcta la cantidad de curas disponibles. En “Bloodborne” hay parte de esto, pero la importancia a la hora de ver la salud de un vistazo rápido recae más en la mecánica de riesgo-recompensa mediante la cual podemos recuperar vida si al recibir daño nos lanzamos rápidamente al ataque y provocamos daño nosotros.

El decidir entonces qué información es la de mayor importancia para el jugador y qué sensaciones busca transmitir el juego nos servirá a la hora de aplicar las distintas teorías de la percepción visual para repartir todos estos datos por la pantalla.

Ante cualquier imagen, el recorrido usual que realiza nuestra vista es: Desde la esquina superior izquierda hacia la esquina inferior derecha, luego sube a la esquina de justo encima para acabar por último el trazado que realiza nuestra mirada en la esquina inferior izquierda. Esto es lo habitual en la cultura occidental pues está relacionado con costumbres que tienen que ver con la educación y lo social, y que influyen en la manera que tenemos de percibir el mundo como por ejemplo nuestra forma de leer de izquierda a derecha. Aunque como es lógico estas teorías no tienen porqué ser seguidas siempre a rajatabla y cada desarrollador puede disponer los elementos del HUD como crea conveniente en función de lo que busque; además, existen más teorías en las que apoyarse para conseguir dirigir la mirada del espectador hacia donde le interese jugando con las formas, los colores, los contrastes o el movimiento.

Además de este recorrido que hace nuestra vista debemos tener en cuenta aspectos como el dispositivo al que vaya dirigido el juego y qué limitaciones tiene. Si la pantalla en la que vamos a jugar es muy pequeña, el tamaño del HUD y los menús debe de ser suficiente para que seamos capaces de leer todo pero sin hacer que nos tape demasiado la acción. Si hablamos de obras para dispositivos móviles habrá que contar con que se controlará de manera táctil por lo que es necesario evitar que nuestras propias manos nos bloqueen la vista tanto del HUD como del juego en sí. Y en los últimos años hasta hemos recuperado títulos retro que se jugaban en vertical aprovechando la portabilidad de Nintendo Switch que nos permite voltear la consola.

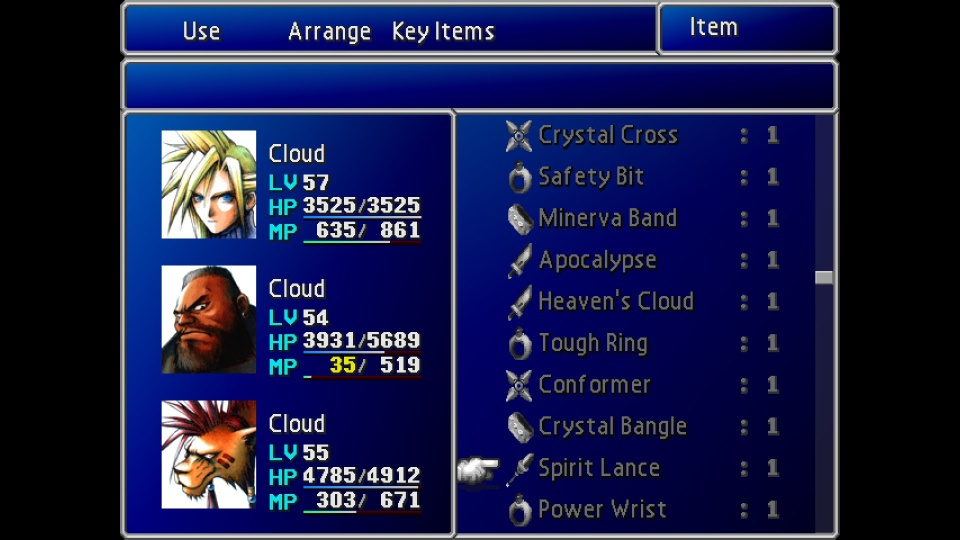

Los menús deben de intentar seguir estas mismas normas estructurando la información según su importancia, que esta sea fácil de leer, de entender e intuitiva. Cuanto más complejas sean las mecánicas de un título más difícil será el diseño de la interfaz pues debe recoger muchos más datos a tener en cuenta, y es obvio que no será lo mismo el diseño de la interfaz de un RTS que de un shooter, como tampoco serán iguales los menús de un plataformas que de un RPG que debe incluir componentes de progresión y personalización del personaje en sus menús.

También se tiene que contemplar que las acciones que sean irreversibles necesiten confirmación y establecer una comunicación constante entre el juego y el jugador, de forma que para aquellas acciones que se extienden a lo largo del tiempo, como por ejemplo el ganar experiencia, esta se recoja en algún tipo de estadística o barra de progresión dentro del menú.

Una vez decidido el cómo se van a organizar todas estas piezas queda otra parte fundamental de los outputs:

La estética

La interfaz no se puede limitar a aportar únicamente la información necesaria, debe de ayudar a la inmersión del jugador. Por tanto, es importante que su estética respete la ambientación del título a la vez que sigue siendo visible en todo momento. Por ello, su diseño sufrirá de variaciones a lo largo de todo el desarrollo del título, pues tiene que funcionar tanto en escenas luminosas como en situaciones de oscuridad, en entornos con gamas de tonalidades frías o calientes, etc.

Con esto en mente, debemos de considerar qué formas utiliza el videojuego para introducir los datos de la interfaz dentro del gameplay. En primer lugar puede optar por dejar algo más o menos inocuo preocupándose únicamente de que sea fácil de ver, como en «Battlefield«, donde además cuenta con que muchos jugadores acabarán quitando el HUD para conseguir una mayor inmersión. O puede decidir ambientar la interfaz de manera temática, como en «Kingdom Hearts», donde cada mundo tenía un HUD diferente que adaptaba elementos propios de ese mundo. En “Grand Theft Auto V” muchos de los menús eran navegables a través del móvil de nuestro avatar y hasta podíamos gestionar algunos aspectos del juego desde una aplicación real para nuestros móviles. Parece lógico, si el objetivo es sumergir al jugador dentro de la partida y conseguir que se identifique con su avatar, trasladar acciones como mirar el móvil en el juego a la acción real de consultar y gestionar información del juego desde nuestro propio móvil, ayudando así a la inmersión.

En segundo lugar está la forma en que introducimos estos elementos dentro del juego, que influye en la forma en que está diseñado el HUD. Existen 4 categorías que engloban todos los tipos de interfaz:

- DIEGÉTICAS.

Son aquellas que existen en el universo del juego, es decir, pueden ser vistas por los propios habitantes del mundo ficticio del videojuego. Este tipo parte de la base de que los juegos sin interfaz resultan mucho más inmersivos, quizás este es el motivo de que su uso más habitual sea en títulos de terror en los que conseguir la inmersión del jugador es aún más importante para conseguir que se asuste.

Tenemos ejemplos como “Outlast” donde la única interfaz que aparece es cuando el protagonista mira a través de su cámara de vídeo. “Alien: Insolation”, en donde sólo la vemos al usar ciertos aparatos o mirando mapas, circuitos y demás en las pantallas que hay presentes en el mundo del juego. “Dead Space”, que refleja la vida que nos queda con una barra integrada en el traje del protagonista y el inventario, menús y otros datos como las armas y la munición que nos queda son proyecciones holográficas en el mundo del juego. O “Metro 2033” que introducía la interfaz de manera parecida e incluso el título del juego y los estudios desarrolladores estaban dentro de ese mundo. Y casos como “Metal Gear Solid V: The Phantom Pain” que combina la interfaz diegética cuando desplegamos el menú con una proyección y la forma de ver nuestra munición, colocada con el siguiente tipo de HUD.

- NO DIEGÉTICAS.

Es la interfaz clásica de la mayoría de videojuegos, donde la información que se muestra está sobreimpresa sobre la pantalla y sólo es visible para el jugador, sin ningún tipo de repercusión en el universo del juego.

- ESPACIALES.

Están integradas en el mundo del juego pero no pertenecen a este. Es decir, los textos que nos indican el camino que debemos seguir en “Splinter Cell: Conviction” no pueden ser vistos por Sam Fisher ni ningún otro personaje, pese a que estén incrustados en piezas de la obra como si perteneciesen a su cosmos. Lo mismo ocurre con los monólogos que se inscriben en el entorno en “What Remains of Edith Finch”. Metal Gear Solid V también usa este tipo de HUD en algunos de sus elementos, como cuando marca enemigos para controlar su posición.

- META.

Es la última categoría a la hora de clasificar una interfaz y también bastante extendida en su uso. La mejor forma de entenderla es en su comparación con la interfaces diegéticas. Si las primeras existían en el mundo del juego y podían ser vistas por sus habitantes además de por el jugador, estas se diferencian en que lo que se muestra al jugador se hace de manera explícita.

Explicado de otro modo: la interfaz diegética es algo que el jugador ve casi por accidente, simplemente porque pertenece al universo del juego y aparece en pantalla, igual que ve los edificios del juego, sus NPCs, etc. Sin embargo, en las meta se ven en pantalla porque están trasladadas de manera explícita para que el jugador las vea. Como las manchas de sangre en la pantalla, el cambio de color de la misma cuando nuestro personaje sufre algún estado alterado, etc. Que veamos la pantalla en rojo no significa que nuestro avatar tenga un chorro de sangre cayéndole desde la frente a los ojos, es simplemente una manera de comunicar al jugador que está siendo herido.

Todos estos factores han de ser valorados para no acabar cayendo en errores como los de “Horizon Zero Dawn”, donde una interfaz demasiado invasiva acaba ensuciando las estampas preciosistas que dibuja su mundo.

Espada y Pluma te necesita

SOBRE EL AUTOR